統計検定準一級の勉強をしている際に、「分散共分散行列は半正定値なので…」といきなり新常識がぶち込まれたので、今回は証明していこうと思います。

まず、分散共分散行列と半正定値の定義を述べ、それから証明します。

もくじ

証明のための下準備

分散共分散行列の定義

(Def)分散共分散行列

k次元確率ベクトル(確率変数k個セット)

\(\boldsymbol{X}=\begin{pmatrix}

X_1 \\

X_2 \\

X_3 \\

\vdots \\

X_k

\end{pmatrix}\)

と、期待値ベクトル

\(\boldsymbol{μ}=\begin{pmatrix}

μ_1 \\

μ_2 \\

μ_3 \\

\vdots \\

μ_k

\end{pmatrix}(但し、μ_i=E[X_i])\)に対して、

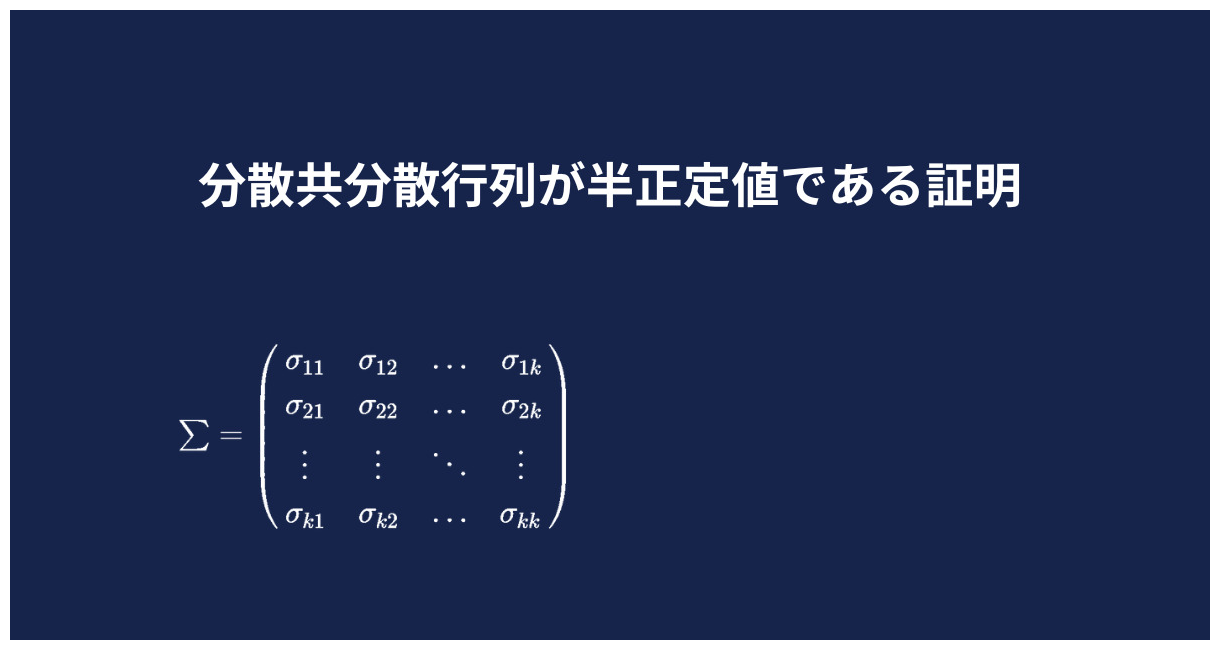

\(\sum=

\begin{pmatrix}

\sigma_{11} & \sigma_{12} & \dots & \sigma_{1k} \\

\sigma_{21} & \sigma_{22} & \dots & \sigma_{2k} \\

\vdots & \vdots & \ddots & \vdots \\

\sigma_{k1} & \sigma_{k2} & \dots & \sigma_{kk}

\end{pmatrix}\) を分散共分散行列と呼ぶ。

(但し、\(\sigma_{ij}=E[(X_i-μ_i)(X_j-μ_j)]\))

半正定値行列の定義

(Def)半正定値行列

行列Aが半正定値であるとは、零ベクトルでない任意のベクトル\(\boldsymbol{x}\in\boldsymbol{R}-{\boldsymbol{{0}}}\)に対して、

$$<\boldsymbol{x},\sum \boldsymbol{x}>=\boldsymbol{x}^T \cdot \sum \boldsymbol{x} \geq 0$$であること。

(但し、\(< , >\)はベクトル内積で\(T\)は転置)

分散共分散行列が半正定値であることの証明

proof(Σが半正定値)

$$\sigma_{ij}=E[(X_i-μi)(X_j-μ_j)]=\frac{1}{N}\sum_{k=1}^{N}(X_ik-μ_i)(X_jk-μ_j)$$

ここで、\(x_ik-μ_i=y_{ik} ,x_jk-μ_j=y_{jk} \)とおき、\(\boldsymbol{y_i}=(y_{i1},\dots ,y_{jk})\)とおくと、$$\sigma_{ij}=\frac{1}{N}\sum_{k=1}^{N}y_{ik}y_{jk}=\frac{1}{N}\boldsymbol{y_i}\cdot\boldsymbol{y_j}$$

とかける。よって、

$$\sum=\frac{1}{N}\begin{pmatrix}

\boldsymbol{y_1}\cdot\boldsymbol{y_1} & \boldsymbol{y_1}\cdot\boldsymbol{y_2} & \dots & \boldsymbol{y_1}\cdot\boldsymbol{y_k} \\

\boldsymbol{y_2}\cdot\boldsymbol{y_1} & \boldsymbol{y_2}\cdot\boldsymbol{y_2} & \dots & \boldsymbol{y_2}\cdot\boldsymbol{y_k} \\

\vdots & \vdots & \ddots & \vdots \\

\boldsymbol{y_k}\cdot\boldsymbol{y_1} & \boldsymbol{y_k}\cdot\boldsymbol{y_2} & \dots & \boldsymbol{y_k}\cdot\boldsymbol{y_k}

\end{pmatrix}=\frac{1}{N}

\begin{pmatrix}

\boldsymbol{y_1}^T \\

\boldsymbol{y_2}^T \\

\boldsymbol{y_3}^T \\

\vdots \\

\boldsymbol{y_k}^T

\end{pmatrix}(\boldsymbol{y_1},\boldsymbol{y_2},\boldsymbol{y_3}\dots,\boldsymbol{y_k})$$

と書ける。

ここで、\(\boldsymbol{Y}=(\boldsymbol{y_1},\boldsymbol{y_2},\boldsymbol{y_3}\dots,\boldsymbol{y_k})\)とおくと、

$$\sum=\frac{1}{N}\boldsymbol{Y}^T\cdot\boldsymbol{Y}$$

と書ける。そして、任意の非零ベクトル

\(\boldsymbol{x}\in\boldsymbol{R}^k-{\boldsymbol{{0}}}\)に対して、

$$<\boldsymbol{x},\sum \boldsymbol{x}>=\boldsymbol{x}^T \cdot \sum \boldsymbol{x}= \frac{1}{N}\boldsymbol{x}^T\cdot\boldsymbol{Y}^T\cdot\boldsymbol{Y}\cdot\boldsymbol{x}=\frac{1}{N}(\boldsymbol{Y}\cdot\boldsymbol{x})^T\cdot\boldsymbol{Y}\boldsymbol{x}$$

$$=\frac{1}{N}<\boldsymbol{Y}\boldsymbol{x},\boldsymbol{Y}\boldsymbol{x}>\; \geq 0 $$

最後の≧0は内積の半正定値性を用いた。

(証明終わり)

あとがき

まずはここまでご覧いただきありがとうございました。

統計の勉強をしっかりしようとすると、ところどころで証明が必要になりますよね。

これからも気になる所は証明していこうと思うので、証明や解説してほしい部分のリクエストや間違っている箇所があれば、コメント欄やお問い合わせからお気軽にお願いします!

それではっ

コメント